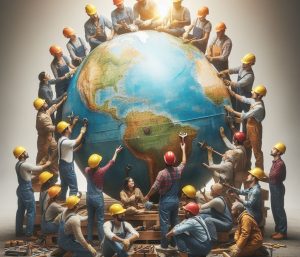

Javier Peña, creador de Hope! y divulgador: «¿Queremos ser la generación de la resignación o de la regeneración?»

Vivimos la catástrofe medioambiental como esa crónica de una muerte anunciada que escribió Gabriel García Márquez: sabiendo lo que va a pasar y a la espera de que nos cuenten cómo ha pasado. Javier Peña quiere revertir esa narrativa nihilista que nos empuja al cinismo sembrando la esperanza de que otro mundo es posible. “Las soluciones están a nuestro alcance y no son imposibles. Por eso, es necesaria una narrativa nueva y más optimista”