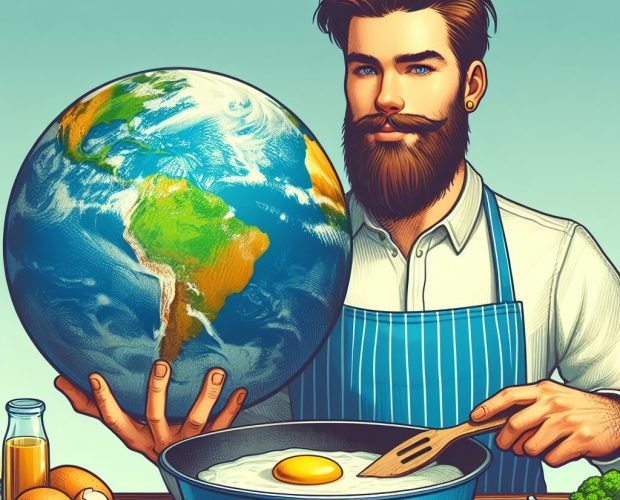

El legionario terraplanista de Masterchef y otros `despertares de la conciencia´

MasterChef llevó a su programa a un orgulloso terraplanista. Lejos de la transparente búsqueda de polémica, a la vista de un show mediocre, las palabras del concursante encierran una creciente y muy peligrosa dinámica. El cinismo que abandona los hechos y se refugia, más cómodo, en la fantasía. Una obstinación fanática que no para de propagarse.