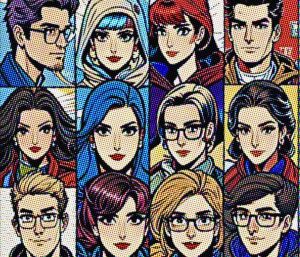

Libros en la selva del ocio digital

E-book, booktubers, booktokers o instabookers. Estos eslabones de la cadena literaria están azuzando el interés patrio por la lectura. Un hábito creciente entre los jóvenes, que han encontrado en las pantallas que prometían alejarlos de los libros, el camino de vuelta a ellos.