«Quien no llora, no mama». El refranero como guía definitiva para triunfar en las redes

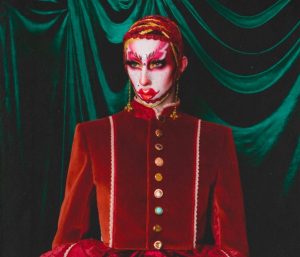

He tenido una revelación. Quien pone en práctica en las redes sociales los refranes castizos desvela un atajo al éxito. Por ejemplo, influencers como By Hermoss, han comprendido que: “quien no llora, no mama” y facturan el aforismo obscenamente.