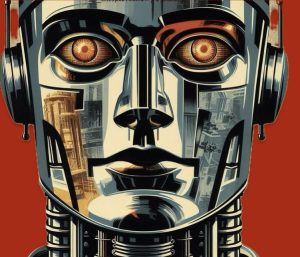

Mirar sin ver: violencia, silencio y desensibilización en el ‘soma’ digital

Quizá nos hemos acostumbrado a mirar sin ver. A deslizarnos entre imágenes de dolor sin saber muy bien qué hacer con ellas. A veces sentimos que estar informados es una forma de estar presentes, de no ser indiferentes. Pero también podría ser que tanta exposición nos esté alejando, poco a poco, de algo más esencial: el juicio, la pausa, la posibilidad de conmovernos de verdad. No es fácil saber cuándo dejamos de sentir o si alguna vez lo hicimos del todo. No hay respuestas claras, solo preguntas que incomodan. Tal vez pensar despacio no resuelva nada, pero podría ser una forma distinta de estar más cerca y de quizás poder entender el valor intrínseco de las cosas.