Las otras dos Españas: carta a la ciudadanía que no está en Twitter

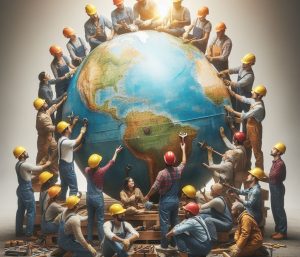

Se oye hablar a menudo de las dos Españas. Pero lejos de la política o la economía, existe una alfabetizada digitalmente y otra que no lo está. La carta de Pedro Sánchez, difundida en redes, es uno de los ejemplos de la obsolescencia a la que se enfrentan quienes se desligan de lo digital en el invasivo sultanato del algoritmo.